În fiecare an, aproximativ 7 milioane de copii sunt raportați autorităților de protecție a copilului pentru posibile abuzuri, dar cum determină autoritățile dacă le place copiilor Gabriel Fernandez sunt în pericol grav și au nevoie de intervenție?

Multe autorități de protecție a copilului se bazează pe evaluările riscurilor oferite de personalul instruit pentru a angaja liniile telefonice în care se raportează abuz suspect, dar unii cred că ar putea exista o modalitate mai bună.

„Există un corp larg de literatură pe care am văzut-o pentru a sugera că oamenii nu sunt bile de cristal deosebit de bune”, a spus Emily Putnam-Hornstein, directorul Rețeaua de date pentru copii și un profesor asociat la USC, a spus în noua serie de documente Neflix „Procesele lui Gabriel Fernandez”. „În schimb, ceea ce spunem este să pregătim un algoritm pentru a identifica care dintre acei copii se potrivește unui profil în care riscul arcului lung ar sugera implicarea viitoare a sistemului”.

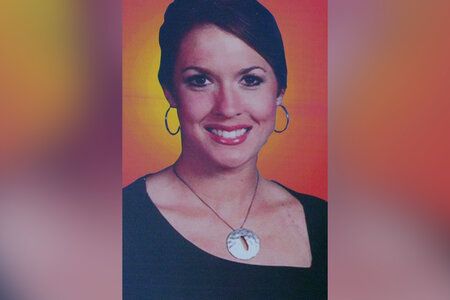

Fernandez a fost un băiat de 8 ani bătut și torturat până la moarte de ai săi mamă si ea iubit , în ciuda apelurilor repetate ale profesorului său și ale altor persoane către autoritățile care au raportat suspectul de abuz. Noua serie din șase părți examinează viața și moartea îngrozitoare a lui Fernandez, dar are și o privire mai largă probleme sistemice în cadrul sistemului de bunăstare a copilului care ar fi putut juca un rol.

Putnam-Hornstein susține că o strategie pentru identificarea mai eficientă a copiilor care prezintă cel mai mare risc ar putea fi utilizarea algoritmilor special creați care utilizează înregistrări administrative și extragerea datelor pentru a determina scorurile de risc pentru fiecare copil.

„Avem de fapt în jur de 6 sau 7 milioane de copii care sunt raportați pentru presupus abuz sau neglijare în fiecare an în SUA și istoric modul în care am luat unele dintre deciziile noastre de screening se bazează doar pe un fel de evaluări intestinale”, a spus ea. „Modelarea predictivă a riscurilor spune doar:„ Nu, nu, nu, să adoptăm o abordare mai sistematică și empirică în acest sens. ””

Putnam-Hornstein și Rhema Vaithianathan, codirectorul Centrul pentru analiza datelor sociale , au reușit să pună în practică ideea în județul Allegheny, Pennsylvania. Perechea a folosit mii de recomandări de maltratare a copiilor pentru a concepe un algoritm care să determine un scor de risc pentru fiecare familie raportată serviciilor de protecție a copilului din județ, conform Center for Health Journalism .

„Există o sută de factori diferiți care sunt luați în considerare”, a explicat Marc Cherna, directorul Departamentului pentru Servicii Umane al județului Allegheny, în seria de documente. „Câteva exemple de bază sunt istoricul bunăstării copilului, istoricul părinților, cu siguranță consumul și dependența de droguri, boala mintală a familiei, închisoarea și condamnările și mai ales dacă există agresiuni și lucruri de genul acesta”.

Datorită volumului mare de apeluri, autoritățile de protecție a copilului din toată țara au sarcina de a stabili dacă o familie ar trebui să fie examinată pentru anchetă pe baza plângerii sau să fie exclusă.

În 2015, 42% din cele 4 milioane de acuzații primite în toată țara, care implicau 7,2 milioane de copii, au fost depistate, potrivit New York Times .

Cu toate acestea, copiii continuă să moară din cauza abuzului asupra copiilor.

Sistemul utilizat în județul Allegheny este conceput pentru a prezice cu mai multă precizie care familii sunt susceptibile să aibă implicarea viitoare a sistemului prin analiza datelor.

'Ceea ce au ecranizatorii sunt multe date', a declarat Vaithianathan pentru The Times. „Dar este destul de dificil să navighezi și să știi care sunt factorii cei mai importanți. Într-un singur apel către C.Y.F. , s-ar putea să aveți doi copii, un presupus făptaș, veți avea mama, s-ar putea să aveți un alt adult în gospodărie - toți acești oameni vor avea istorii în sistem pe care persoana care examinează apelul poate să o investigheze. Dar creierul uman nu este atât de capabil să valorifice și să dea sens tuturor datelor. ”

Instrumentul de screening al familiei Allegheny folosește o tehnică statistică numită „data mining” pentru a analiza tiparele istorice pentru a „încerca să facă o predicție despre ceea ce s-ar putea întâmpla” într-un caz dat, a spus ea în docu-series.

Fiecărui caz i se acordă un scor de risc cuprins între 1 și 20 - clasificând fiecare caz fie cu risc ridicat, cu risc mediu sau cu risc scăzut.

Rachel Berger, medic pediatru la Spitalul de Copii din Pittsburgh, a declarat pentru The Times în 2018 că ceea ce face valoroasă analiza predictivă este că elimină o parte din subiectivitatea care intră de obicei în proces.

ce s-a întâmplat cu părul de trandafir chihlimbar

„Toți acești copii trăiesc în haos”, a spus ea. „Cum funcționează C.Y.F. alegeți care sunt cele mai periculoase atunci când toți au factori de risc? Nu îți vine să crezi cantitatea de subiectivitate care intră în deciziile de protecție a copilului. De aceea, îmi place analiza predictivă. În cele din urmă aduce o anumită obiectivitate și știință la deciziile care pot schimba viața atât de incredibil. ”

Tiria Moore este încă în viață?

Dar au existat și critici care susțin că utilizarea analizei predictive se bazează pe date care ar putea fi deja părtinitoare. Cercetările anterioare au arătat că minoritățile și familiile cu venituri mici sunt adesea supra-reprezentate în datele colectate, creând potențial o prejudecată împotriva familiilor afro-americane sau a altor familii minoritare, conform docu-series.

„Biasurile umane și biasurile de datemergeți mână în mână unul cu celălalt”, A declarat Kelly Capatosto, asociat senior de cercetare la Institutul Kirwan pentru Studiul Rasei și Etniei de la Universitatea de Stat din Ohio, potrivit Centrului pentru Jurnalism de Sănătate. „Cu aceste decizii, ne gândim la supraveghere și la contactul sistemului - cu poliția, agențiile de protecție a copilului, orice agenții de asistență socială. Va fi supra-reprezentat în comunitățile (cu venituri mici și minoritare). Nu este neapărat o indicație a locului în care au loc aceste instanțe. '

Erin Dalton, director adjunct al biroului de analiză, tehnologie și planificare al județului Allegheny, a recunoscut că este posibilă o prejudecată.

„Cu siguranță, există părtinire în sistemele noastre. Abuzul asupra copiilor este văzut de noi, iar datele noastre nu sunt o funcție a abuzului real asupra copiilor, ci o funcție a celui care este raportat ”, a spus ea în seria Netflix.

Dar județul a mai spus Centrului pentru Jurnalism de Sănătate că a constatat că primirea de beneficii publice scade scorurile de risc pentru aproape cei ai familiilor sale.

Tjudețul este „foarte sensibil” la această preocupare și face analize continue asupra sistemului pentru a determina dacă grupurile au fost vizate în mod disproporționat, a mai spus Cherna în docu-series.

Sistemul județului Allegheny este deținut de județul însuși, dar au existat și unele critici față de alte sisteme de screening private.

Departamentul Illinois pentru servicii pentru copii și familie a anunțat în 2018 că nu va mai folosi un pachet de analiză predictivă dezvoltat de Eckerd Connects, un organism nonprofit, și de partenerul său cu scop lucrativ MindShare Technology, în parte pentru că compania a refuzat să ofere detalii despre ce factori au fost folosite în formula lor, potrivit The Times.

Se pare că sistemul a început să desemneze mii de copii ca având nevoie de protecție urgentă, oferind mai mult de 4100 de copii din Illinois o probabilitate de deces sau de rănire cu 90% sau mai mare, Chicago Tribune raportat în 2017.

Cu toate acestea, alți copii care nu au primit scoruri de risc ridicat au ajuns să moară din cauza abuzului.

„Analiza predictivă (nu prevedea) niciunul dintre cazurile nefaste”, a declarat Beverly „B.J.”, directorul Departamentului pentru Servicii pentru Copii și Familii. Walker a spus Tribunei. „Am decis să nu continui cu acel contract.”

Daniel Hatcher, autorul cărții „ Industria sărăciei: exploatarea celor mai vulnerabili cetățeni din America ”A comparat unele dintre sistemele analitice cu o„ cutie neagră ”, spunând în seria de documente că modul în care iau deciziile nu este întotdeauna clar.

„Nu au cum să-și dea seama cum decid de fapt un nivel de îngrijire care are un impact uriaș asupra unei persoane”, a spus el.

Putnam-Hornstein a recunoscut că sistemele analitice predictive nu sunt capabile să determine comportamentul viitor, dar crede că este un instrument valoros care le permite persoanelor care examinează să ia decizii mai informate cu privire la copiii care ar putea avea cel mai mare risc.

„Sper că aceste modele vor ajuta sistemul nostru să acorde mai multă atenție subsetului relativ mic de recomandări în care riscul este deosebit de mare și vom putea dedica mai multe resurse copiilor și familiilor în mod preventiv”, a spus ea, potrivit la Centrul pentru Jurnalism de Sănătate. „Nu vreau ca nimeni să vândă în exces modelarea predictivă a riscurilor. Nu este o minge de cristal. Nu ne va rezolva toate problemele. Dar, în marjă, dacă ne permite să luăm decizii ușor mai bune și să identificăm cazurile cu risc ridicat și să le sortăm din cazurile cu risc scăzut și să le ajustăm în consecință, aceasta ar putea fi o dezvoltare importantă pe teren. ”